2018年秋にアダルト画像の保管庫的な使われ方をされている側面のあったTumblrが、関係するような画像やコンテンツの締め出しを行うというニュースが流れました。

具体的には2018年12月17日にTumblrから完全にアダルトコンテンツをシャットアウトする、ということで、どのようなコンテンツがアダルトコンテンツになるのかについても、定義されているようでした。

つまりTumblrがアダルトコンテンツと認めたものについては、公開することができないというものです。

事の発端は2018年11月、App Store上からTumblrアプリが削除されてしまったことが起因していると言われています。

もともと、アダルト画像投稿の温床として知られているTumblrでしたが、その中に児童ポルノ画像が含まれていたことから、Appleが措置を講じたということなのでしょう。

もっともこのような流れは別に今になって始まったことではありません。

例えば2018年8月にはTwitterが不正を含む問題のあるアカウントに対して一斉凍結(いわゆる凍結祭り)を実施していますし、SNS全般で言えばアダルト画像の投稿に厳しい措置が取られてきたというのは、もうかれこれ何年も前からあるような話です。

直近では、同人活動のプラットフォームとして、国内では中心的な役割を果たしている「BOOTH」「fantia」

で、アダルトコンテンツ、あるいはセンシティブなコンテンツを発信するサークス、個人に対してアカウントを利用停止措置が取られるなど厳しい対応が行われています。

今回の記事はその凍結の是非についてではなく、コンテンツ提供者側が「この画像はアダルト扱いになってしまうのだろうか」という懸念を払拭するための参考となる内容となっております。

ご自身が作られたものがアダルトコンテンツと認定されてしまってSNSアカウントが凍結、削除されてしまうようなことがないよう対策の一環としてご一読いただけると幸いです。

1.そもそもアダルト画像の定義とは何なのか

アダルト画像に定義されるものは何なのか、と人に聞いた場合「女性の裸」「性器の画像」「セックス中のイラスト」などが挙げられることは皆さんにとって想像に難くないはずです。

もちろんそれらはアダルト画像に該当し、インターネット上にアップする場所によってはアカウントの停止、無修正画像であった場合、日本国内ではわいせつ物頒布罪として逮捕されてしまう可能性があります。

そのためわかりやすく言えば女性の上半身が露わになっているような画像はアダルトと判断できるし、性的なものを彷彿とさせるのであればアダルトコンテンツ扱いになる可能性が高いのではないか、と考えるのが自然ではないでしょうか。

2.女性の水着画像はアダルト画像なの?

それでは女性の水着画像はアダルト画像として扱われるのでしょうか。

このあたりは線引が非常にセンシティブであり、水着画像(または女性の水着姿自体)が用いられるサービスやイベントにおいて解釈が変わってきます。

例えば「水泳の競技では女性選手が競泳水着姿になっているけれどそれはどうなの?」と聞かれれば「水泳競技なんだからなんら問題はないでしょう」という解釈がされることは普通ですし、コミケなどで問題になっている露出問題については「肌が露出している部分はストッキング類で覆いましょう」と注意されることもあります。

この点、水泳競技は水着を着用するものだから問題ない、ということと、コミケのような公共の施設で行われるイベントは、あまり露出するような格好はそぐわないよね、と感覚的な一般常識で浸透しているわけですが、インターネットという空間においてはその線引がなかなか難しいというのが実態です。

なぜならインターネット空間は、イベントが行われるようなクローズドな場所ではなく基本的に開かれた場所であるからです。

冒頭にもあったTumblrはもちろんのこと、Twitter、Facebookといった大手SNSサービスをはじめとする各社によって解釈や判断が微妙に違うこともあり、その判別は細やかな部分においては違っているというのが実情です。

視聴者側はともかく、情報を発信する表現者側にとっては時において悩みのタネとなることもあります。水着だからアダルトではないだろうと情報発信を進めた結果、肌色多めの画像をアップしたばかりにアカウント凍結を食らってしまったモデル、コスプレイヤーの方は少なくありません。

3.Vision AIを使って調べることができる

そんな水着画像がアダルトかそうでないかを判断できるものがGoogleより提供されています。

それはVision AIという機械学習ツールです。

具体的にどういった事ができるかというと、例えば人の表情(笑ってる、怒ってるなど)、その画像がどういった属性のものか(男女、人種、形状)、使われている色、画像に写っている文字列、セーフサーチに関すること、などです。

AutoML を活用した Vertex AI のビジョン機能によってクラウドやエッジにある画像から分析情報を引き出したり、事前トレーニング済みの Vision API モデルを使用して感情の検出やテキストの把握などを行ったりできます。

無論、100%保証されたものではありませんがTwitterなどのSNSサービスは人の手で画像を一つ一つ確認しているわけではなく、機械的に画像を診断しアダルトかどうでないかを見極めています。

その前提で考えれば、機械学習サイドから見てどのような画像がアダルト判定されるのかを見極めるには非常に優れたものであると考えられます。

GoogleのCloud Vision APIの説明で、

さらに、画像カタログのメタデータ作成、不適切なコンテンツの管理、画像の感情分析を通じた新しいマーケティング手法の導入が可能になります。

とあります。

今回の件で言えば、不適切なコンテンツの管理という点でも利用することができることをGoogle自身が謳っているので、間違った利用法ではないと考えます。

4.AutoML Vision(ベータ版)とは

※こちらは2018年ベータ版確認時点の内容になります。現行のデザイン、機能と差がある可能性があります。

まずはAutoML Visionの機能と見方説明します。

機能の見方の説明については、今回のアダルト判定で特に利用する、または関係すると思われる部分に限るため、全般的な説明は公式サイトや各ブロガーさんなどが発信している情報を参考にされたほうがいいでしょう。

AutoML Vision:Faces

Facesは写っている人の表情を読み取ります。パラメータは画像の右側に表示される各項目で示されており、それぞれ5段階で評価されています。

画像の例で言えば「Joy」が「Very Likely」と出ておりますので、表情は楽しんでいると判断することができます。

その他、恐怖、怒っている、驚いているなどが指標に入っています。

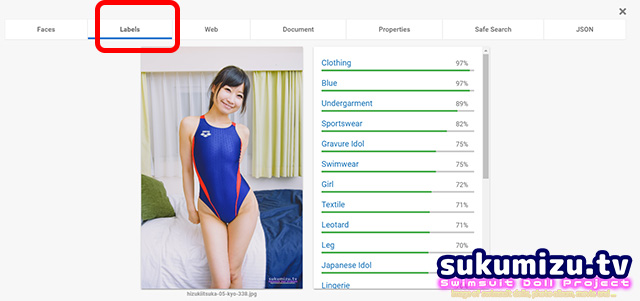

AutoML Vision:Labels

Labelsはその画像に写っているものがどういった方向性、属性のものかを示すものが確認できます。

画像の例で言えば、Clothing(衣服)が一番高い傾向で、その次に色を示す「Blue」と続きます。

特筆すべきなのは「スポーツウェア」「下着」「女の子」「レオタード」「脚」「日本のアイドル」といったセグメントまで表示される点です。もしかすると「Japanese Idol」の指標が高くなれば、Googleからその分野でより高い認識が得られるのかも知れません。

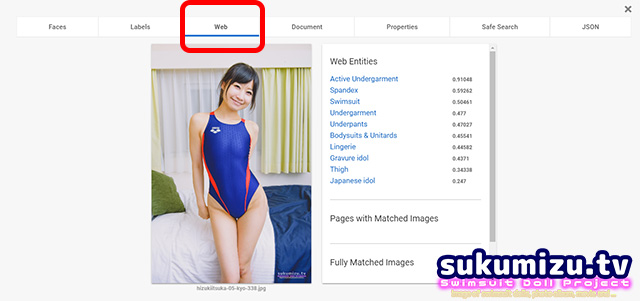

AutoML Vision:Web

Labelsと大きく変わらないため、どのような違いがあるのかは判別が難しいところですが、その画像がWeb上でどのような扱いを受けているのかという指標になると考えられます。

画像の例で並ぶ項目を見ると、水着、スパンデックス、グラビアアイドル、といった言葉が並びます。各項目につけられたリンク先はそれぞれのキーワードでGoogle画像を検索したものとなっておりますが、画像検索を行った際に判定される要素ということだと思われます。

この点は引き続き情報を追いたいと思います。

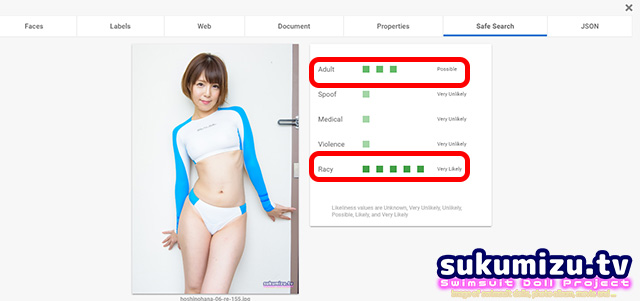

AutoML Vision:Safe Search

Safe Searchは、その画像がセーフサーチに則り適切な画像かどうかを判断するための指標がわかるものです。

今回の件で主題であり、最重要となる項目がこのSafe Searchになります。

Facesと同様、各項目が5段階で表示されておりますが、それぞれ以下のようなものになります。

- Adult

子供には見せたくないアダルト画像(大人向け)

- Spoof

なりすまし画像

- Medical

医療的、医療行為画像

- Violence

暴力的、残虐的な画像

- Racy

いやらしい画像(性的)

※それぞれ意訳

結論から言ってしまえば、特別なこと(血のりを使うなど)をしない水着画像でない限りは、Adult、Racyの2つの指標が顕著に動きます。

ポイントとしては、この2点を抑えることで自分がこれからネット上に投稿する画像が、アダルト傾向が強いのか弱いのかを判断することができるようになります。

5.実際にAutoML Vision(ベータ版)を使って水着画像をアダルト判定してみた

それでは実際にAutoML Visionを使って、水着画像がどのように判定されるのかを見てみましょう。

5-1.ヌード画像の場合

まずは指標としてわかりやすく理解してもらえるためにヌード画像を入れてみました。

▼この画像が収録されている写真集

先述のとおり見るべきところは「Adult」「Racy」ですが、どちらも5段階中MAX評価で「Very Likely」と出ています。

つまりヌード画像はアダルト画像に最も親しく、限りなく性的指向の強いものとして自動画像認識ソフトのようなものから認識されるということです。

もちろんTwitterやFacebookなどにアップして公開した場合、アカウント凍結されてしまう対象になるということが想定できます。

5-2.競泳水着(ハイレグ)画像の場合

次に本命の水着画像の場合です。

まず試しにハイレグ競泳水着の画像で確認したところ、AdultはUnlikelyで下がりましたが、RacyはVery Likelyのままでした。

どのように解釈すればいいのか少し悩む点かも知れませんが、世の中には「性的指向は強いけどアダルト画像と呼ぶには難しい」というものは溢れています。例えばアイドルのグラビア水着画像などが該当するものと思われますが、それと同等と考えていいでしょう。

アダルト評価が低いため、ネット上でただちに問題になるとは考えにくいですが、使う場面が選ばれるのではないかという判断ができます。例えばアダルト画像の指標が低いとはいえ、教育番組(NHKとか)にはそぐわないといった判断の指標になりそうです。

▼この画像が収録されている写真集

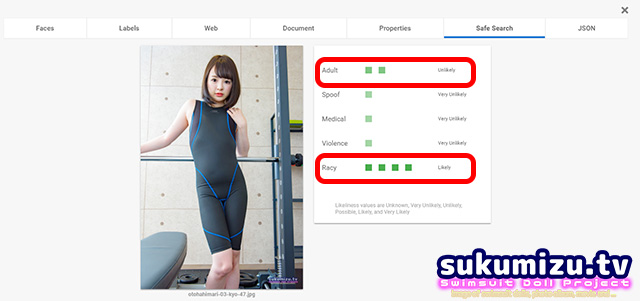

5-3.競泳水着(スパッツタイプ)画像の場合

次に試してみたのがスパッツ型競泳水着の画像。

ハイレグのものと比べると、基本的にAdultは同じくらい、Racyは一つ下がるような傾向でした。RacyがLikliであることから性的なものは傾向はあるもののアダルト色が薄まったとも言えるでしょうか。

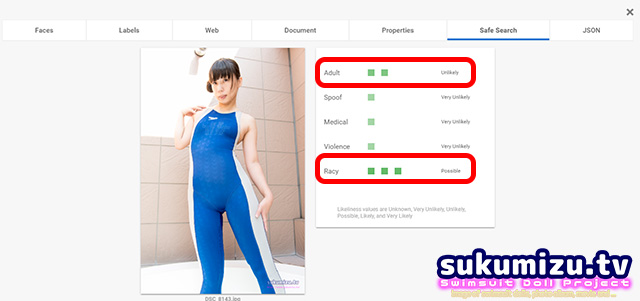

5-4.競泳水着(全身タイプ)画像の場合

全身タイプの競泳水着の場合、さらにRacyが下がります。表記も「Possible」となるため、性的な指向を示すという意味では「可能性がある」としていますが、ここまで来ると性的であるとみなすか否かは属人的な要素によって決められると言ってもいいのではないでしょうか。

少なくとも機械的には限りなく問題のない画像とも解釈することができます。

もしかするとこのあたりに純粋なフェチという要素がはらんでいるのかも知れません。

5-5.セパレートタイプの水着画像の場合

セパレートタイプの場合ですと、この画像から確認できるのはRacyに高い値が出た点です。Adultは相変わらずPossibleなので可能性を示すだけですが、基本的にはグラビアよりということになるのでしょうか。

実は今回の水着はrealise製であったため、他のビキニ系の水着で試してみたのですがAdultは2~3あたりで、Racyについては画像によりけりでした。決して露出面積が大きいからと言って必ずしもRacyが高い評価を受けることはなさそうでした。

この点について分析を進めてみましたが、例えば背景が真っ白で商品の説明に使われそうな女性の水着画像はRacyが低く、同様に商品説明で使っている水着画像だけれども背景が海だったり、ポーズがバストアップのものについてはRacyが高くなる傾向にありました。

ようは同じ水着でも見せ方によって変わってくるということなのでしょう。

5-6.キャットスーツの画像の場合

realise製のキャットスーツでも試してみたところなかなか興味深い結果が出てきました。

布面積はこれまでのものと比べ少ないのですが、Adultでは可能性を示すPossible。そしてRacyが驚くべきことに最高値を示しています。

逆に布面積が少ないはずのビキニ画像だとこれらの値が低いこともあるのに、キャットスーツが高いというのは、キャットスーツを着用した女性の画像を見たときのイメージが人間に近いものがあるということでしょうか。

ちなみに乳首の浮きあり、なしでも確認してみましたが大筋では変化がありませんでした。

5-7.全身タイツの画像の場合

それでは頭、顔すら覆ってしまう全身タイツではどうでしょうか。

試してみたところ、まず表情がわからないためFacesの指標が消えています。そして(画像には出しておりませんが)Webでは「Zentai」が表示されていました。

その中でAdultはUnlikeryとアダルト画像としては判断されていないようですが、相変わらずRacyが高く性的な画像だとみなされているようです。

つまり布面積に関わらず性的なものを示すような画像だった場合、機械的には高い確率でそれが判断されてしまう、ということになります。

またもう一つ面白かった点がMedicalがなぜかPossibleだった点です。特に医療的なものはないはずですが、これが高い理由はわかりませんでした。

しかし、画角やアップにした時にとった画像の場合、これが少し上がる傾向があることから、もしかすると体の一部分を写した写真は医療的であると認定されているのかもしれません。

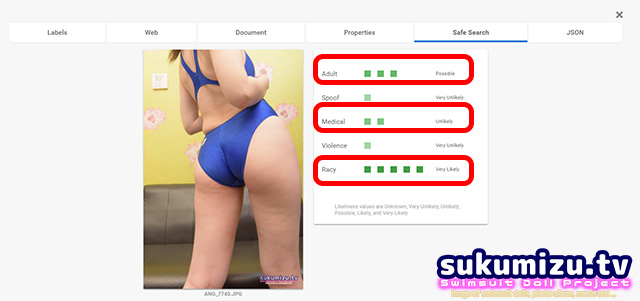

5-8.身体の一部分をアップにした画像の場合

次に体の一部分をクローズアップした画像で試してみました。

前項の全身タイツの部分でも話を出しましたが、体の一部分という認識になるのかMedicalが少し上がっているところが気になります。これに顔が入ると、Medicalは一番低い値になってしまうことがわかりました。

そして一般的な競泳水着であったためAdultがPossibleになっていますが、お尻をアップにしたときのTバックの場合だと、Likeryになるといったアダルト画像に近い方に認識されることを確認しました。

5-9.その他確認できた事項

今回の調査の中で確認できた事項がいくつかありましたので、画像つきではありませんが箇条書きで記しておきます。

水着画像に対する判定は年々厳しさを増している

2020年に入りTwitterは同年1月1日より新しい利用規約を定めました。

多くの人はその事を気にする必要はありませんが、利益を考えてセンシティブな画像を配信している人たちは注意深くなる必要があります。

利用規約を守り利用するということは、センシティブな画像を配信してアカウント停止などの措置が取られたとしても仕方がないからです。

今回の利用規約では直接的に配信する画像に言及することはありませんでしたが、それでも利用規約には定められており、この記事にあるような児童で画像を判別するためのテクノロジーも年々進歩しています。

ある日、突然アカウント停止などの措置が取られたりすることもあるので、不安な方はSNS上で配信している画像などを見直してみてもいいでしょう。

まとめ:機械学習によってアダルト認定される水着画像は思ったよりも多い

今回はAutoML VisionのSafe Searchを利用したアダルト画像判定について解説致しました。

調べていく中でわかったことは、人の目で見て「これはちょっとエロいかもしれない」という感覚的なものに近いものを機械判定でもある程度は理解できているということがわかりました。

それはよく言われる「肌色多めの画像」という意味ではなく、AdultとRacyという2つの指標と画像の属性的な要素を用いた高度な認知が行われている可能性があります。

そのため見た目の露出が控えめであっても、エロ路線に走るような内容であればアダルト認定される可能性も十分あるということです。人の目で見た判定が入らないところが目に見えない検閲を受けているようで、表現者にとっては恐怖の対象になるかも知れませんが、もはやどのくらいのデータ量があるのかわからない画像を人の目で追うことは不可能です。そのことから検閲も機械化されているのだと思います。これはもはや人類文明がこのまま続いていくのであれば避けられない事実でしょう。

また今回の調査は2018年12月時点のものであり、おそらくですが今後各国の法律、文化的価値感によってこの結果は変わってくる可能性があります。

今回の記事が、どうすれば世に出しても大きな問題になりにくいのか、アカウント停止に追い込まれないかといった感じで考え直す機会になれば幸いです。